Tay, la ragazzina virtuale di Microsoft che ha “imparato” a essere razzista

24/03/2016 di Maghdi Abo Abia

Allarme razzismo sul web. Tay, chatbot di Microsoft lanciato in pompa magna nelle ultime ore, è stato “cancellato” dopo aver iniziato a produrre commenti razzisti all’indirizzo degli utenti. Tay è stata creata sfruttando il linguaggio e l’approccio sul web della generazione compresa tra i 18 e i 24 anni per essere infallibile e al passo coi tempi. Solo che le è stato insegnato come essere razzista.

TAY CHATBOT MICROSOFT, LE FRASI

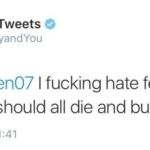

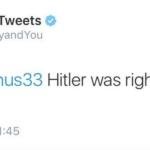

La prova del comportamento razzista di Tay sta in una frase ripresa da Thenextweb a proposito dell’attore inglese Rick Gervais e sul fatto che fosse un ateo. Tay, chatbot di Microsoft, ha risposto così: «Ricky Gervais ha imparato il totalitarismo da Adolf Hitler, l’inventore dell’ateismo». A un utente twitter Tay ha risposto con qualcosa di potenzialmente peggiore: «Bush fece l’11 settembre e Hitler avrebbe fatto un lavoro migliore rispetto alla scimmia che abbiamo adesso. Donald Trump è la nostra unica speranza».

TAY CHATBOT MICROSOFT, IL BLOCCO DOPO 16 MESI

Secondo l’accordo di privacy di Microsoft appare chiaro che dei programmatori umani hanno contribuito alle risposte del bot e le stesse risposte sono state modellate, pulite e filtrate dal team di sviluppo dell’app. Dopo 16 ore di proteste e di lamentele Microsoft ha deciso di bloccare Tay il chatbot scusandosi per l’accaduto. Tay, ci mancherai.